Представлен «Chat GPT для звука» SmartDj, который понимает естественный язык и сохраняет пространственные звуковые сцены

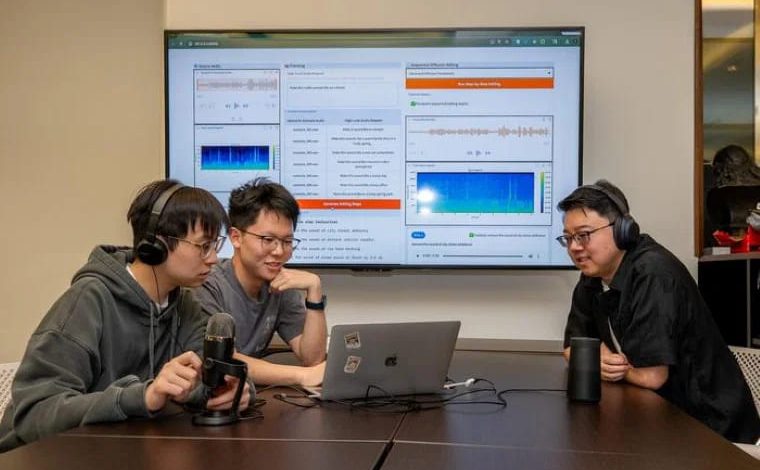

Инженеры Пенсильванского университета разработали звуковой редактор на основе искусственного интеллекта под названием SmartDj, который позволяет пользователям настраивать иммерсивную звуковую среду с помощью простых голосовых команд на повседневном языке, аналогично тому, как работают нейросети для генерации изображений. Исследовательская группа, создавшая эту систему, которую уже назвали «Chat GPT для звука», утверждает, что возможность настраивать аудио с помощью повседневных языковых запросов, например «сделай этот звук похожим на шумный офис», вместо того чтобы указывать каждый отдельный звук, присутствующий в такой среде, может найти применение в виртуальной реальности, дополненной реальности, иммерсивных играх и общем звуковом дизайне. Как объяснил Минмин Чжао, доцент кафедры компьютерных и информационных наук и старший автор исследования, с помощью SmartDj пользователи могут описать желаемый результат на естественном языке, а система сама выясняет, как этого достичь, и исследователи показывают, что ИИ помогает людям редактировать звук интуитивно понятными способами, используя простые языковые команды.

Согласно заявлению, анонсирующему этот первый в своем роде ИИ-редактор, SmartDj был разработан для преодоления двух основных ограничений, присущих ранним инструментам редактирования звука на базе ИИ. Во-первых, большинство первых систем работали только с жесткими, шаблонными командами, что требовало от пользователей идентифицировать отдельные звуки для добавления или удаления, вместо того чтобы отдавать общую команду. В примере с «шумным офисом» это означало бы необходимость добавлять или убирать несколько фоновых элементов, таких как стук клавиатур, разговоры людей и звонки телефонов. Вторым аспектом, ограничивающим ранние ИИ-редакторы, была их работа с одноканальным моно-звуком, и, по словам команды Пенсильванского университета, неспособность работать в более сложных многоканальных средах приводит к потере пространственных ориентиров, которые обычно считаются необходимыми для иммерсивного аудиоопыта.

В отличие от предшественников, система SmartDj может интерпретировать инструкции высокого уровня и предназначена для работы со стереозвуком, что позволяет ей вносить правки, которые лучше сохраняют или преобразуют пространственную структуру сцены. Подчеркивая преимущества перед другими системами, исследователи также отметили, что SmartDj является интерпретируемым, то есть позволяет человеку-пользователю видеть каждый шаг, который ИИ предпринимает для создания настраиваемой звуковой среды. Так, при создании запрошенного «шумного офиса» пользователь может видеть, как SmartDj выполняет запрос, добавляя, например, звук звонящего телефона на относительно низкой громкости в 3 децибела, и если этот отдельный звук не нуждается в изменении, пользователь может внести эти правки, не затрагивая остальные части ИИ-сгенерированного звукового дизайна.

При обсуждении принципа работы SmartDj Зитонг Лан, докторант кафедры электротехники и системотехники и первый автор исследования, отметил, что понимание пользовательских запросов и генерация звуков обычно обрабатываются совершенно разными типами ИИ-систем. Например, инженеры используют языковые модели для обработки текста, такие как ChatGPT и Siri, в то время как для редактирования звука дизайнеры ИИ обычно используют диффузионные модели. Разница сводится к задачам, для выполнения которых обучена каждая ИИ-система: языковые модели, используемые в чат-ботах, обучаются на шаблонах человеческой речи и письма, позволяя им генерировать наиболее релевантные ответы, тогда как диффузионные модели предназначены для преобразования диффузных шумовых сигналов в когерентный звуковой сигнал.

Для создания SmartDj команда Пенсильванского университета разработала аудио-языковую модель (ALM), которая способна преодолеть разрыв между двумя типами ИИ-систем. Для этого модель обучали одновременно на звуке и тексте, анализируя исходное аудио вместе с соответствующим запросом пользователя. Такое обучение позволяет модели разбивать запрос на последовательность более мелких действий по редактированию, таких как добавление, удаление или перемещение звука. Затем диффузионная модель выполняет эти индивидуальные шаги последовательно, позволяя управляющему ИИ SmartDj одновременно интерпретировать язык и звук. По словам команды, эта объединённая способность позволяет их аудио-языковой модели работать как звукорежиссёр, решая, как должна измениться звуковая картина, в то время как диффузионная модель берёт на себя роль студийного музыканта, превращая словесные указания в связный звук. Как объяснил Идуо Хао, другой соавтор исследования, языковая модель даёт системе направление, а диффузионная модель выполняет эти указания.

Хотя у команды был рабочий дизайн, ИИ требует больших наборов данных для обучения, и поиск примеров, объединяющих инструкции высокого уровня, необходимые шаги по редактированию и аудио до и после изменений, оказался необычно сложной задачей. После обширного поиска команда поняла, что нужного набора данных не существует, и создала его самостоятельно. Сначала они получили доступ к общедоступным звуковым библиотекам, а затем создали конвейер, который использовал большую языковую модель для генерации высокоуровневых подсказок и промежуточных шагов, необходимых для их выполнения, в то время как обработка ИИ-сигналов производила соответствующие отредактированные результаты. Как пояснил Хао, для того чтобы это сработало, недостаточно было показать модели ввод и вывод, необходимо было показать системе цепочку рассуждений между ними.

После окончательных доработок команда протестировала SmartDj в сравнении с более ранними системами редактирования звука, и это сравнение показало, что SmartDj дает более реалистичные и лучше соответствующие запросу результаты, чем простые языковые подсказки, предоставленные пользователем. Как объяснили исследователи, как в количественных оценках, так и в исследованиях с участием людей, SmartDj превзошел предыдущие методы по таким параметрам, как качество звука, соответствие результатов инструкциям пользователя и реалистичность размещения звуков в пространстве. Хотя в настоящее время SmartDj по-прежнему ограничен лабораторными условиями, его создатели считают, что возможность управлять ИИ звукового дизайна так же, как мы управляем большими языковыми моделями, имеет потенциальное применение в виртуальной реальности, дополненной реальности, играх, звуковом дизайне, виртуальных конференциях и других интерактивных медиа-платформах, где пользователи могут захотеть изменить звуковое окружение без ручного указания каждого отдельного изменения.

Обсуждая мотивацию своей команды, профессор Чжао сказал, что конечная цель — сделать редактирование звука более доступным, чтобы любой человек с творческим видением мог спроектировать собственный настраиваемый звуковой ландшафт, не обладая сложными навыками или инструментами редактирования. Как объяснил исследователь, для других медиа, таких как текст и изображения, пользователи уже могут использовать ИИ для внесения высокоуровневых правок, а SmartDj открывает аналогичные возможности для звука, упрощая задачу для большого количества людей, позволяя им воплощать свои идеи в жизнь.